Paper 研习社新功能上线啦!

大家除了浏览或者参与论文推荐,还可以一键打包下载论文合集,针对长期更新的论文合集,你能通过系统消息第一时间收到更新的通知,让你的科研的道路上,绝不慢人一步!

点击链接迅速跳转论文集下载界面:

https://paper.yanxishe.com/library

「本周论文推荐精选」是 Paper 研习社推出的全新栏目,展现社友们在研习论文的过程中,推荐自己所阅读到的优秀论文,帮助大家一起学习、讨论每个领域最新、最精彩的学术论文。

①

#图像处理# #深度学习#

《HandAugment:一种用于HANDS19挑战任务1-基于深度的3D手势估计的简单数据增强方法》

推荐理由:

这篇论文考虑的是3D景深图像中预估手势的问题。

这篇论文提出了一个简单的数据增强方法HandAugment,包含两阶段的神经网络学习:第一阶段在迭代的模式下抽取手部图像块,并根据深度图预估手的初始姿态,过滤掉噪音图块(例如背景与手臂)。被抽取出的图块与初始化手部姿态被代入第二阶段的神经网络,以获取最终的手部姿态。

这种两阶段策略极大提升了手势识别的准确率,并在HANDS19挑战任务1-基于景深的3D手势识别大赛上获得了第一名。

②

#自然语言处理# #计算语言学#

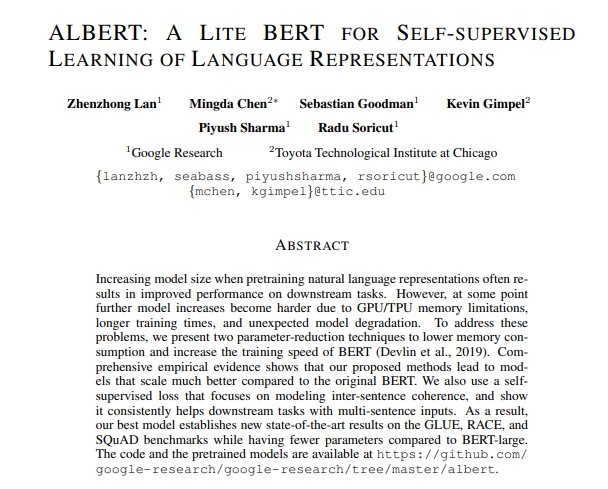

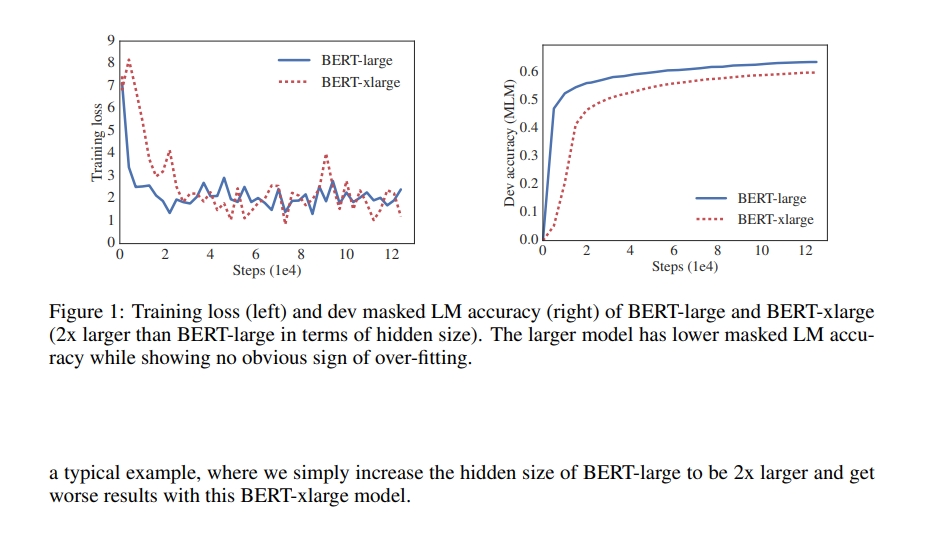

《ALBERT:一种用于语言表征自监督学习的精简BERT》

推荐理由:

bert模型开启了自然语言理解的预训练时代,很多和语义解析的相关任务都可以通过bert模型来提高效果,但是这也带来了一些问题,bert参数过多,模型过于复杂,需要较大的计算能力才可以支持,所以这导致了很大的问题,如何让模型变小,降低内存消耗,减少训练时间称为了当前的问题,也是必要的方向。

albert正式解决这个问题的,它提出了两种降低内存消耗和提高BERT训练速度的参数约简技术。不仅解决了前面的问题,并且这种预训练模型比之前的bert的预训练模型的效果更好,在很多任务上都得到了超越。

论文链接:

https://paper.yanxishe.com/review/8078

推荐人:magic(燕山大学 | 计算机技术)

③

#深度卷积神经网络#

《【北大/诺亚/鹏城/悉大】AdderNet:能否让深度学习摆脱乘法运算?》

推荐理由:

这是一篇来自华为诺亚方舟实验室的论文,于2020年1月1日上线arXiv。本文探究的目标为更高效的深度卷积神经网络。(似乎称作“模型压缩”不太妥当?因为参数量、运算量、参数精度都未减少,但是将乘法替代为加法为推断效率提供了极大的增长空间)

为了提升深度神经网络的运行效率、减少不必要的运算,常见的方法有网络剪枝、知识蒸馏等等。本文则另辟蹊径,尝试让卷积神经网络摆脱乘法而只使用高效的加法运算。

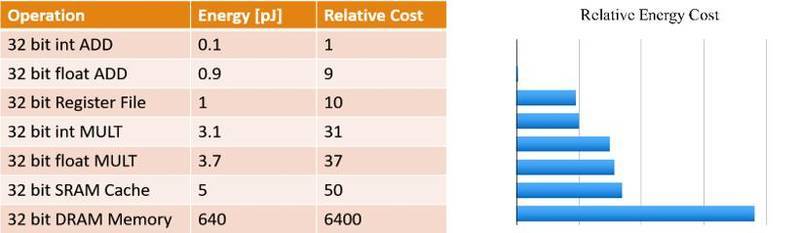

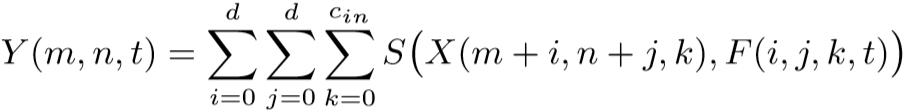

卷积神经网络的实现中,卷积运算是通过卷积核与输入特征的互相关(cross-correlation)运算实现的,而这涉及大量浮点数的乘法运算——要知道,计算机完成一次32位浮点乘法运算往往是加法运算的几倍!如果能将互相关运算替代为效果相近而仅涉及加法的运算,岂不是可以极大地提升CNN的运行效率?

32位浮点运算的相对能耗

那么问题来了:互相关的本质是什么呢?是衡量卷积核与输入特征的相似度。这里,作者大胆地使用L1距离的相反数代替互相关运算,作为衡量相似度的另一种途径。

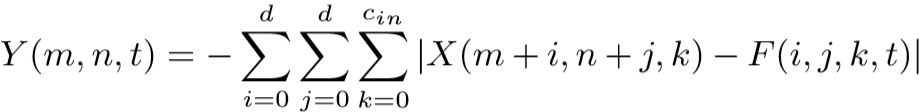

使用互相关实现的卷积运算,X为输入特征,F为卷积核,S()为乘法,Y为层的输出

将S()换为L1距离

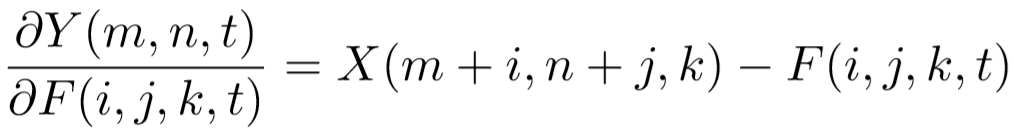

那么问题又来了:模型如何通过反向传播优化?如果对L1距离求导,那么结果只能是0和±1(认为L1距离等于0时导数为0),相当于对X(m+i,n+j,k)-F(i,j,k,t)求的符号函数——这并不能很好地使得模型向最优的方向优化。因此,作者在这里使用了X与F的差作为每层“卷积”核的梯度进行反传:

同样,X也需要梯度来回传至上层,而且与F的梯度不同的是:这个梯度还会影响到上面的所有的层(存在梯度爆炸的可能性),更需要精心的设计。因此,在这里作者使用了HardTanh(即将y=x用±1截断,防止梯度过大)使得梯度值(F-X)处于±1范围之内。

除此之外,本文还提出了针对加法网络的自适应性学习率调整策略。将所有卷积层替换为加法层的AdderNet-ResNet50在ImageNet上达到了74.9%的Top-1准确率和91.7%的Top-5准确率(使用乘法运算实现卷积的ResNet50准确率才不过76.2%和92.9%),在性能损失极少的条件下大大地减少了运算时间。

注:尽管卷积层完全未使用乘法,AdderNet-ResNet50仍然在层间采用了涉及乘法运算的批归一化(Batch Normalization)(毕竟L1距离的相反数一定是非正的)。但是与卷积层的乘法运算相比,批归一化的乘法运算量完全不在一个数量级上,因此可以被忽略不计。

论文链接:

https://paper.yanxishe.com/review/7948

推荐人:温蒂•斯普林

④

#计算语言学#

《纽约摄政科学考试从“ F”到“ A”:Aristo项目概述》

推荐理由:

人工智能已经在国际象棋,围棋和扑克,甚至《危险》等游戏上获得了非凡的掌握,但是各种各样的标准化考试仍然是一个巨大的挑战。即使在2016年,最好的AI系统在8年级科学考试挑战中也仅达到59.3%。

这篇论文报道了在纽约8年级摄政科学考试中取得了空前的成功,该系统首次在该考试的非图表多项选择(NDMC)问题上得分超过90%。此外,基于最近的语言模型的成功,我们的Aristo系统在相应的12年级科学考试NDMC问题上超过了83%。在看不见的测试问题上得出的结果在不同的测试年份和这种测试的不同变体中都是可靠的。他们证明了现代的NLP方法可以精通此任务。虽然不是一般问题解答的完整解决方案(问题是多项选择,并且领域仅限于8年级科学),但它代表了该领域的重要里程碑。

论文链接:

https://paper.yanxishe.com/review/7846

推荐人:IloveNLP(华东师范大学计算机科学与技术系,中国科学院大学 客座学生)

⑤

#生物信息学#

《蛋白质相互作用提取的知识注意网络》

推荐理由:

从已发表的科学文献中提取蛋白质-蛋白质相互作用(PPI)为精确医学工作提供了额外的支持。但是,许多当前的PPI提取方法需要大量的特征工程,并且不能充分利用知识库(KB)中的现有知识。 KB包含大量有关实体和关系的结构化信息,因此在PPI提取中起着关键作用。

本文提出了一种知识感知注意力网络(KAN),以融合有关蛋白质对的先验知识和用于PPI提取的上下文信息。所提出的模型首先采用对角残疾多头注意力机制来对上下文序列以及从知识库中学习到的知识表示进行编码。然后,使用新颖的多维注意机制来选择最能描述编码上下文的特征。在BioCreative VI PPI数据集上的实验结果表明,该方法可以获取序列中不同单词之间的知识感知依存关系,并可以产生新的最新性能。

论文链接:

https://paper.yanxishe.com/review/8315

推荐人:考伯特•赫蒂

✎✎✎

除了上述的的五篇精选论文推荐,我们还为你精心准备了可以一键下载的论文集:

2019十大经典学术论文盘点

下载地址:https://paper.yanxishe.com/packages/454

NIPS, ACL, EMNLP 2019 最佳论文集 附Review

下载地址:https://paper.yanxishe.com/packages/453

年度精选 深度学习中的不确定性量化

下载地址:https://paper.yanxishe.com/packages/455

ICCV 2019 | 最新公开的51篇 Oral Paper 合集

下载地址:https://www.yanxishe.com/resourceDetail/1010

EMNLP 2019 | 10篇论文实现代码合集及下载

下载地址:https://www.yanxishe.com/resourceDetail/1013

NeurIPS 2019 GNN 论文合集

下载地址:https://www.yanxishe.com/resourceDetail/1006

AAAI (1996-2019)历年最佳论文合集

下载地址:https://www.yanxishe.com/resourceDetail/991

快来下载试试吧!

想要阅读更多精彩论文?

点击阅读原文跳转 paper.yanxishe.com